IV - DES DONNéES à L'INFORMATION

3- COMMENT mettre en évidence certaines caractéristiques (Transformation d'Image)?

Toujours dans le but de faciliter l’interprétation et l’analyse des images, celles-ci peuvent être transformées. Des opérations arithmétiques (addition, soustraction, multiplication, division) sont appliquées aux données spectrales d’origine pour les combiner et les transformer en de « nouvelles » images qui mettent en évidence certains éléments de la scène. Il est ainsi possible par exemple d’augmenter la résolution spatiale d’une image multispectrale en la fusionnant avec une image panchromatique (opération appelée pan-sharpening, voir aussi Résolution spectrale) ou d’appliquer des opérateurs mathématiques à différentes bandes afin de calculer des indices ou rapports spectraux permettant de mettre en évidence certaines caractéristiques de la zone d’étude (par exemple, l’activité photosynthétique).

3.1- Pan-sharpening

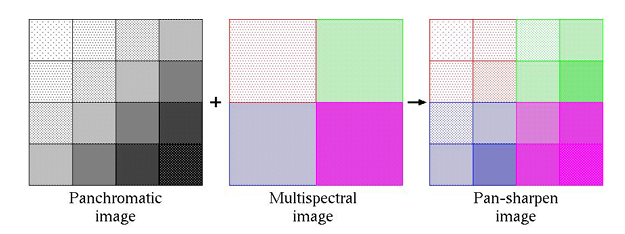

Les images obtenues par les différents types de capteurs des systèmes d'observation de la Terre ont des caractéristiques différentes, notamment en ce qui concerne le nombre de bandes spectrales et la résolution spatiale (taille des pixels). En général, il faut trouver un compromis entre ces deux paramètres. En effet, les données multispectrales ont des résolutions plus faibles que les données enregistrées en mode panchromatique (une seule bande spectrale large couvrant l’ensemble du spectre de la lumière visible).

Pour certaines applications, on souhaiterait cependant pouvoir disposer du meilleur des deux aspects, càd avoir des données à haute résolution spatiale ET multispectrales. Une telle combinaison est possible grâce à un procédé qui consiste à fusionner une image multispectrale à basse résolution et une image monospectrale à haute résolution pour créer une image qui cumule les deux avantages.

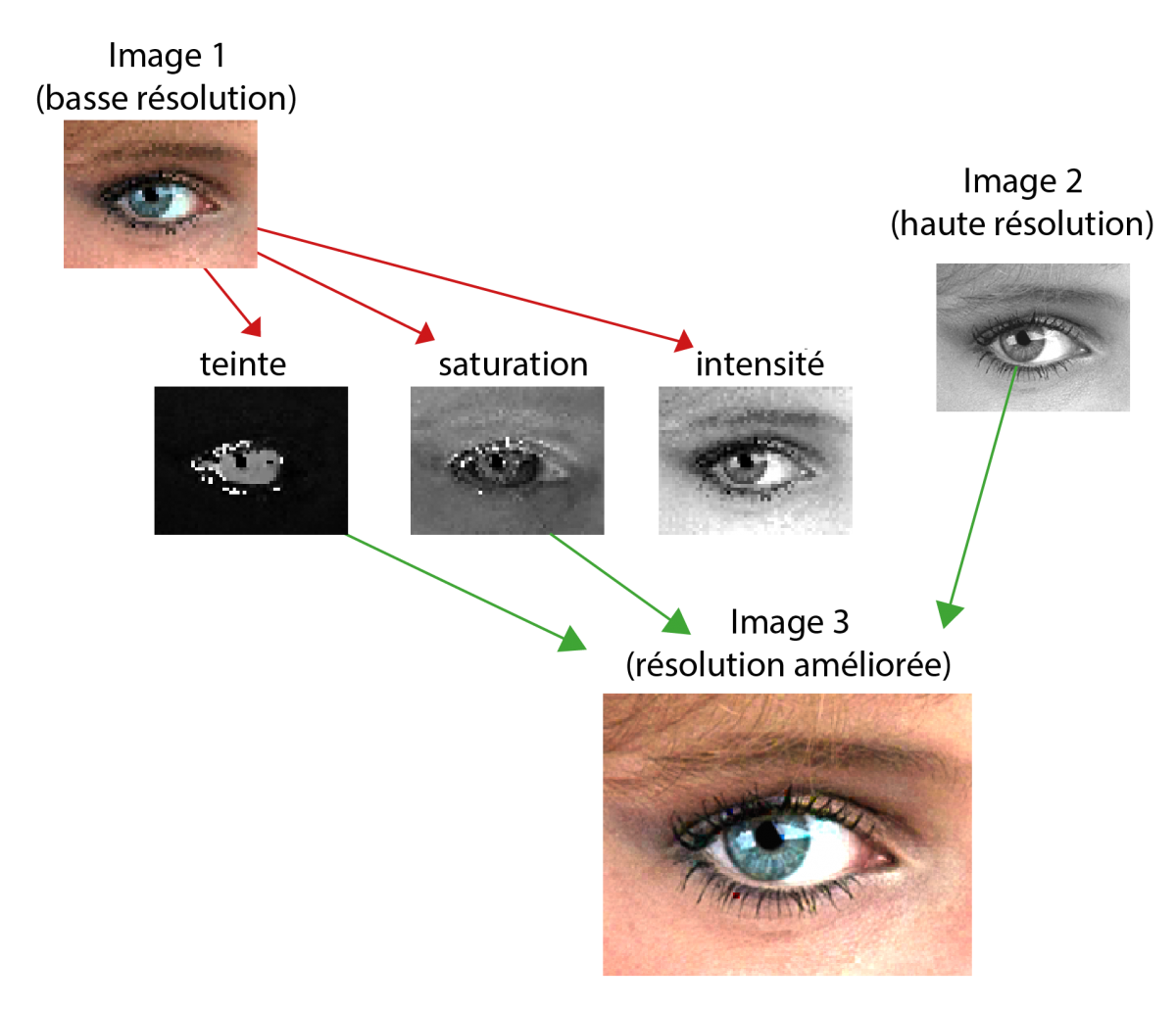

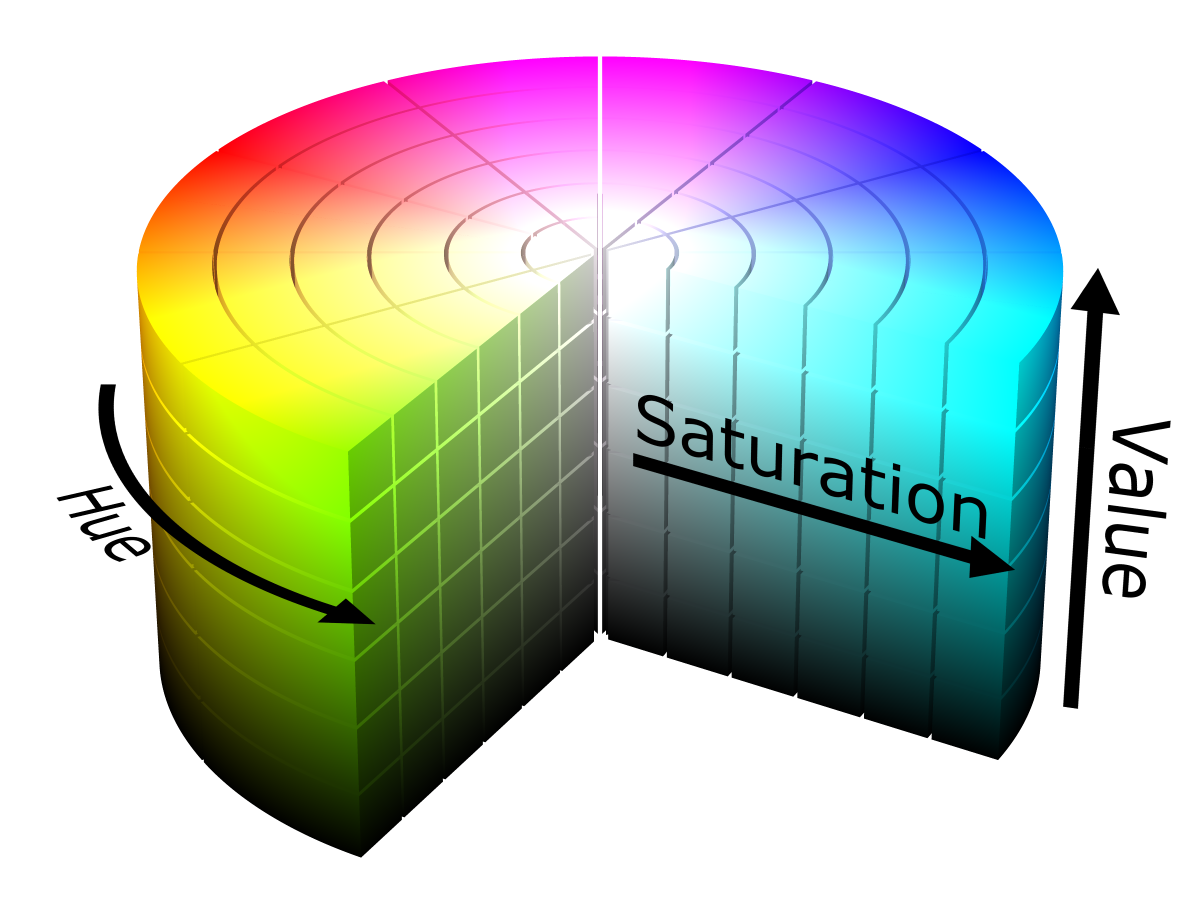

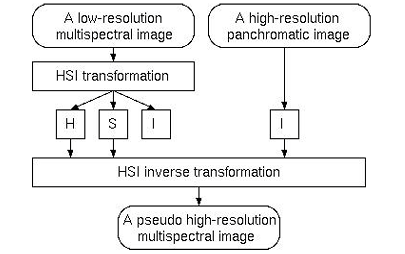

Pour ce faire, l'image multispectrale (l'image en couleurs réelles dans l'illustration Pléiades ci-dessous), enregistrée en rouge, vert et bleu (en anglais RGB), est décomposée en 3 composantes qui décrivent la couleur de chaque pixel: la teinte, la saturation et l'intensité (en anglais HSI pour Hue, Saturation, Intensity) ou la teinte, la saturation et la valeur (HSV pour Hue, Saturation , Value).

Cette transformation du système de coordonnées du modèle de couleurs RGB est appelée "RGB vers HSI" (rouge, vert, bleu vers teinte, saturation, intensité) ou RGB vers HSV.

On remplace ensuite la composante intensité de l'image à basse résolution par l'image panchromatique et on effectue la transformation inverse ("HSI vers RGB").

Pour illustrer cette technique sur des images satellitaire, voici un extrait d'une image de la basilique de Koekelberg à Bruxelles acquise par le satellite Pléiades. Les images multispectrale (mode XS du satellite, avec une résolution de 2 m) et panchromatique (mode P, avec une résolution de 50 cm) ont été fusionnées pour créer une image multispectrale à 50 cm de résolution ("pan-sharpened" image).

|

|

Image multispectrale 50 cm

|

|